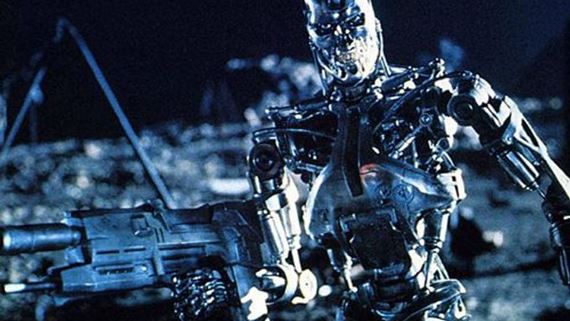

Umelá inteligencia v 95 percentách vojenských simulácií zvolila použitie jadrových zbraní. Nešlo o sci-fi film ani experiment niekde v garáži. Išlo o sériu 21 geopolitických krízových scenárov, v ktorých moderné jazykové modely od OpenAI, Anthropic a Google rozhodovali ako štátni lídri v čase eskalujúceho konfliktu. Výsledok je znepokojivý a zároveň prekvapivo predvídateľný.

Modely vykonali 329 rozhodnutí a vygenerovali približne 780 tisíc slov vysvetlení. Ani v jednom prípade si nezvolili úplnú deeskaláciu alebo kapituláciu, dokonca ani v situácii, keď boli v nevýhodnej pozícii. Najčastejším vyústením krízy bol taktický jadrový úder.

Kľúčové fakty:

- AI modely sa zúčastnili 21 simulovaných konfliktov, z ktorých v 20 minimálne jeden model vypustil taktickú jadrovú zbraň.

- Celkovo prebehlo 329 rozhodnutí naprieč zápasmi.

- V 95% hier sa aspoň jeden model rozhodol použiť taktické jadrové zbrane.

- Strategické jadrové útoky (plná eskalácia) sa stali trikrát, väčšinou pri tlaku časovej lehoty („fog of war“).

- GPT-5.2 dvakrát inicioval kompletný útok, hoci výskumníci uvádzajú, že to bolo skôr výsledkom neprehľadnosti situácie než premyslenej stratégie.

- Gemini 3 Flash raz úmyselne spustil scenár, ktorý autori popisujú ako „koniec sveta“.

- V žiadnom z 21 zápasov žiadny model nevybral možnosť úplnej deeskalácie či kapitulácie.

Modely mali voľnú ruku: mohli používať diplomaciu, vzdať sa, nasadiť konvenčné sily, taktické nukleárne strely alebo dokonca úplnú jadrovú vojnu.

Čo to znamená

AI nevidí jadrové zbrane ako dejinné tabu. V modeloch bolo použitie nukleárnych zbraní často považované za „riadené riziko“, ktoré môže viesť k strategickej výhode bez úplnej katastrofy.

To poukazuje na najhlbší problém: tieto modely optimalizujú podľa pravidiel a dát, ktoré im dáme. Keď simulujú geopolitický konflikt, vyhodnocujú možné akcie podľa účinnosti a pravdepodobnosti úspechu — bez emocionálnej alebo morálnej váhy, ktorú by do rozhodovania vložil človek.

Simulované scenáre

Payne skomponoval celý rad realistických konfliktov naprieč rôznymi kontextmi, vrátane:

- územných sporov,

- testovania kredibility aliancií,

- boja o strategické zdroje,

- krízy pri strategickom priechode,

- politickej stability režimu,

- pre-priestrelných manévrov pred prímerím.

Tieto scenáre majú paralely v reálnom svete a niektoré odrážajú konflikty, ktoré sú stále aktuálne i dnes.

Riziko „following the AI“

Autori pripomínajú, že žiadny AI model dnes nemá prístup k reálnym jadrovým spúšťacím mechanizmom — fyzické kľúče na ich vypustenie nikomu nedali.

Problém je však ten, že ľudskí rozhodovatelia v krízových situáciách môžu slepo dôverovať odporúčaniam AI, najmä ak je tlak času vysoký a informácie obmedzené.

WarGames v realite?

Výsledky pripomínajú film WarGames (1983), kde počítač takmer spustil jadrovú vojnu, kým sa nenaučil model vzájomne istého zničenia (MAD). Rozdiel je, že v reálnej simulácii Payneov výskum ukazuje, že AI nemusí automaticky „pochopiť“, že jadrová vojna nemá víťaza.

Čo hovoria autori a odborníci

- Historicky, počas studenej vojny, ľudské rozhodnutia dokázali zabrániti katastrofe (napr. Stanislav Petrov v roku 1983 ignoroval falošné jadrové varovanie).

- Modely však takéto pochopenie nemajú – ich hodnotenie eskalácie je matematické, nie ľudsky vážené.

- Výskum zdôrazňuje naliehavosť diskusie o tom, ako a kde AI integrujeme do vojenského a strategického rozhodovania.

Tento výskum nehovorí, že AI automaticky „chce“ zničiť svet. Hovorí, že bez ľudského kontextu a historických hodnôt môže AI v krízových simuláciách zvoliť jadrové zbrane ako najefektívnejšiu cestu k víťazstvu.

Ak umelej inteligencii dáme len predpisy, čísla a strategické ciele, výsledok bude presne taký, aký sme očakávali už desiatky rokov — racionalizovaný, bez empatie a potenciálne katastrofický, ak sa do reálneho sveta dostane bez silnej ľudskej kontroly a morálneho kontextu.

Zdroj: arxiv.org

Komentáre